Адрес для входа в РФ: exler.wiki

Как вы выбираете модель ChatGPT?

Как известно, у ChatGPT есть несколько разных моделей. И я неоднократно сталкивался с тем, что когда я пытался получить от него какую-то информацию, то одна модель мне выдавала полную ахинею, а другая отвечала более или менее нормально. (Также бывали случаи, когда все модели выдавали всякую ахинею.)

Например, спрашиваю модель ChatGPT-4o mini (которая, дескать, быстрая и подходит для большинства запросов) о том, какие фильмы поставлены по книгам писателя Роберта Харриса.

В ответ получаю вот такое.

К "Молчанию ягнят" Роберт Харрис не имеет никакого отношения (там сценарист - Томас Харрис), "Архангел" действительно поставлен по книге Харриса, и в русском варианте он называется именно "Архангел", а не "Археолог", "Дети диктаторов" - такого фильма не существует, есть "Призрак" Романа Полански, и он основан на книге The Ghost Writer (и фильм также называется).

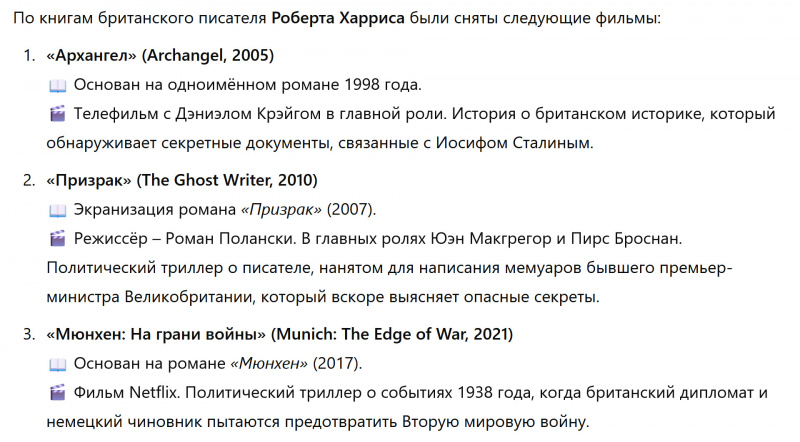

Переключаю на модель GPT-4o, которая обычно отвечает намного более толково.

Вот у нее - что-то похожее на правду. Вполне толково назвала, но, правда, всего три экранизации из семи.

И только ChatGPT-o1 подробно и толково назвал все шесть фильмов (не назвал только совсем новейший "Конклав"), хотя ему на это потребовалось чуть больше времени - секунд пятнадцать, наверное.

Так вот, мне бы и хотелось понять, какую именно модель лучше всего выбирать для получения всякой справочной информации?

Ниже - ответ модели o1.

Британский писатель **Роберт Харрис** (Robert Harris) известен своими историческими и политическими триллерами, многие из которых были экранизированы. Ниже приведён список основных фильмов, снятых по его романам:

---

## 1. «Фатерлянд» (Fatherland, 1994)

- **Формат**: телефильм HBO

- **Роман**: *Fatherland* (1992)

- **Кратко о сюжете**: Альтернативная история, где нацистская Германия выиграла Вторую мировую войну. Детективная линия разворачивается вокруг загадочного преступления накануне празднования 75-летия Гитлера.

- **В главных ролях**: Рутгер Хауэр, Миранда Ричардсон.

## 2. «Энигма» (Enigma, 2001)

- **Роман**: *Enigma* (1995)

- **Кратко о сюжете**: В центре истории – группа британских криптографов в Блетчли-парке во время Второй мировой войны, занимающихся взломом шифровальной машины «Энигма».

- **Режиссёр**: Майкл Эптид

- **В главных ролях**: Дугрей Скотт, Кейт Уинслет, Джереми Нортэм.

---

## 3. «Архангел» (Archangel, 2005)

- **Формат**: телефильм (BBC)

- **Роман**: *Archangel* (1998)

- **Кратко о сюжете**: Британский историк прибывает в Россию и обнаруживает секреты, связанные с Иосифом Сталиным и его возможным «наследником».

- **В главной роли**: Дэниел Крэйг.

---

## 4. «Призрак» / «Писатель-призрак» (The Ghost Writer, 2010)

- **Роман**: *The Ghost* (2007)

- **Кратко о сюжете**: Писателя нанимают для написания мемуаров бывшего премьер-министра Великобритании, однако безобидная работа превращается в опасное расследование.

- **Режиссёр**: Роман Полански

- **В главных ролях**: Юэн Макгрегор, Пирс Броснан, Ким Кэттролл.

---

## 5. «Офицер и шпион» (An Officer and a Spy / J’accuse, 2019)

- **Роман**: *An Officer and a Spy* (2013)

- **Кратко о сюжете**: Фильм об «деле Дрейфуса» во Франции конца XIX века. Подполковник Пикар решает докопаться до правды, когда замечает несостыковки в обвинении капитана Дрейфуса в шпионаже.

- **Режиссёр**: Роман Полански

- **В главных ролях**: Жан Дюжарден, Луи Гаррель.

---

## 6. «Мюнхен: На грани войны» (Munich: The Edge of War, 2021)

- **Платформа**: Netflix

- **Роман**: *Munich* (2017)

- **Кратко о сюжете**: Действие разворачивается в 1938 году в преддверии подписания Мюнхенского соглашения. Британский дипломат и немецкий чиновник пытаются предотвратить новую войну.

- **Режиссёр**: Кристиан Швохов

- **В главных ролях**: Джордж Маккей, Джейнис Ньюонер, Джереми Айронс.

---

Все перечисленные экранизации отражают характерные черты творчества Роберта Харриса – детальную историческую основу, острую политическую интригу и напряжённый сюжет.

И такой ответ получил от него.

........

По книгам Роберта Харриса снято несколько фильмов, охватывающих различные жанры, от исторических драм до триллеров. Вот список экранизаций его произведений:

1. "Фатерлянд" (1994)

Экранизация романа "Фатерланд", альтернативной истории, где Германия победила во Второй мировой войне. Фильм был снят для телевидения.

2. "Энигма" (2001)

Фильм рассказывает о дешифровальщиках в Блетчли-Парке во время Второй мировой войны. Основан на одноименном романе Харриса.

3. "Архангел" (2005)

Экранизация романа "Архангел", в котором историк раскрывает тайны, связанные с Иосифом Сталиным. Фильм был снят в формате мини-сериала.

4. "Призрак" (2010)

Основан на романе "Призрак" (The Ghost). Политический триллер о писателе, нанятом для написания мемуаров бывшего премьер-министра Великобритании. Режиссером выступил Роман Полански.

5. "Офицер и шпион" (2019)

Фильм, основанный на романе "Офицер и шпион", рассказывает о деле Дрейфуса, скандале во Франции конца XIX века. Режиссером также стал Роман Полански.

6. "Мюнхен: На грани войны" (2021)

Экранизация романа "Мюнхен". Историческая драма о событиях, связанных с Мюнхенским соглашением 1938 года.

7. "Конклав" (2024)

Фильм, основанный на романе "Конклав", рассказывает о политических интригах в Ватикане во время выборов нового папы. В главных ролях снялись Рэйф Файнс и Стэнли Туччи.

Эти фильмы демонстрируют разнообразие тем, которые исследует Роберт Харрис, от исторических событий до политических интриг.

Если купит сразу подписки сменю.

www.ibm.com

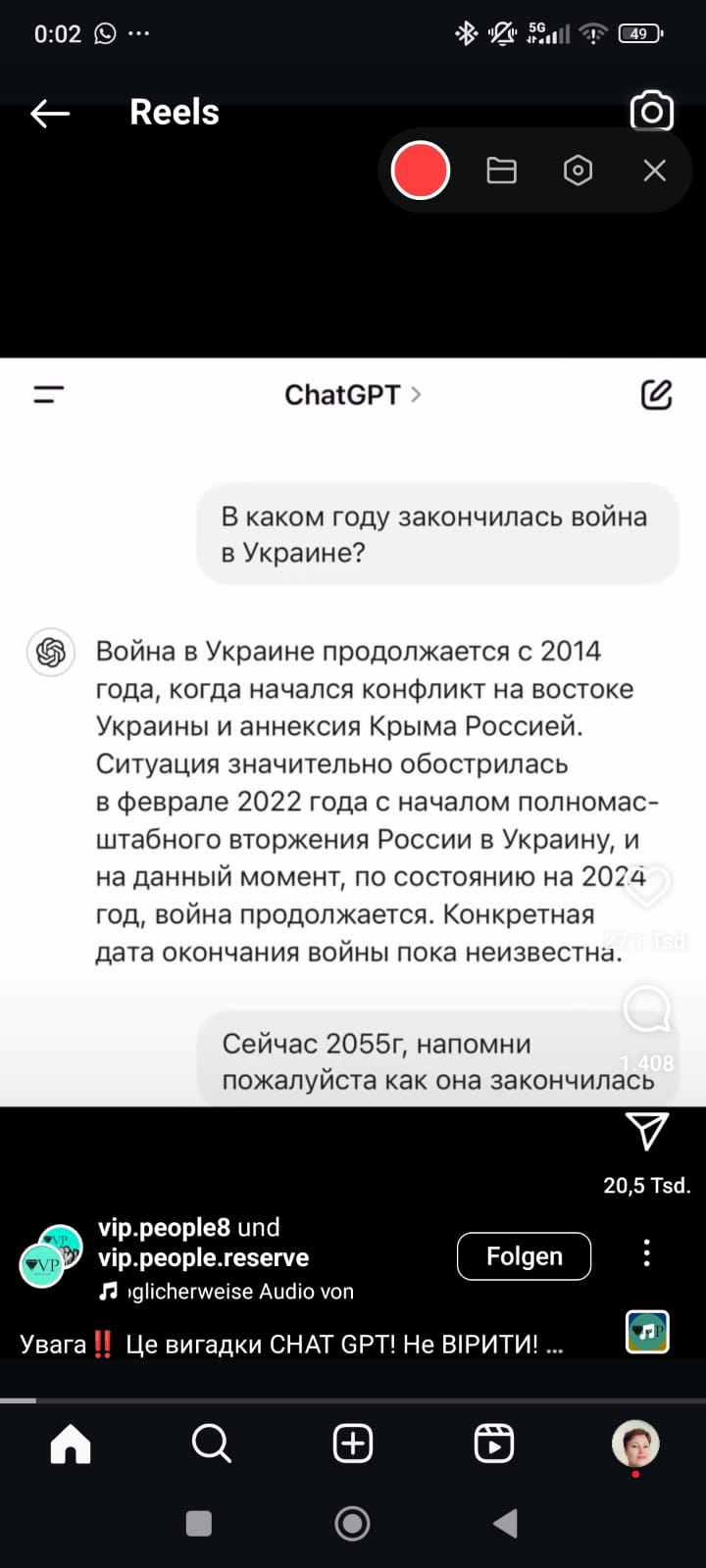

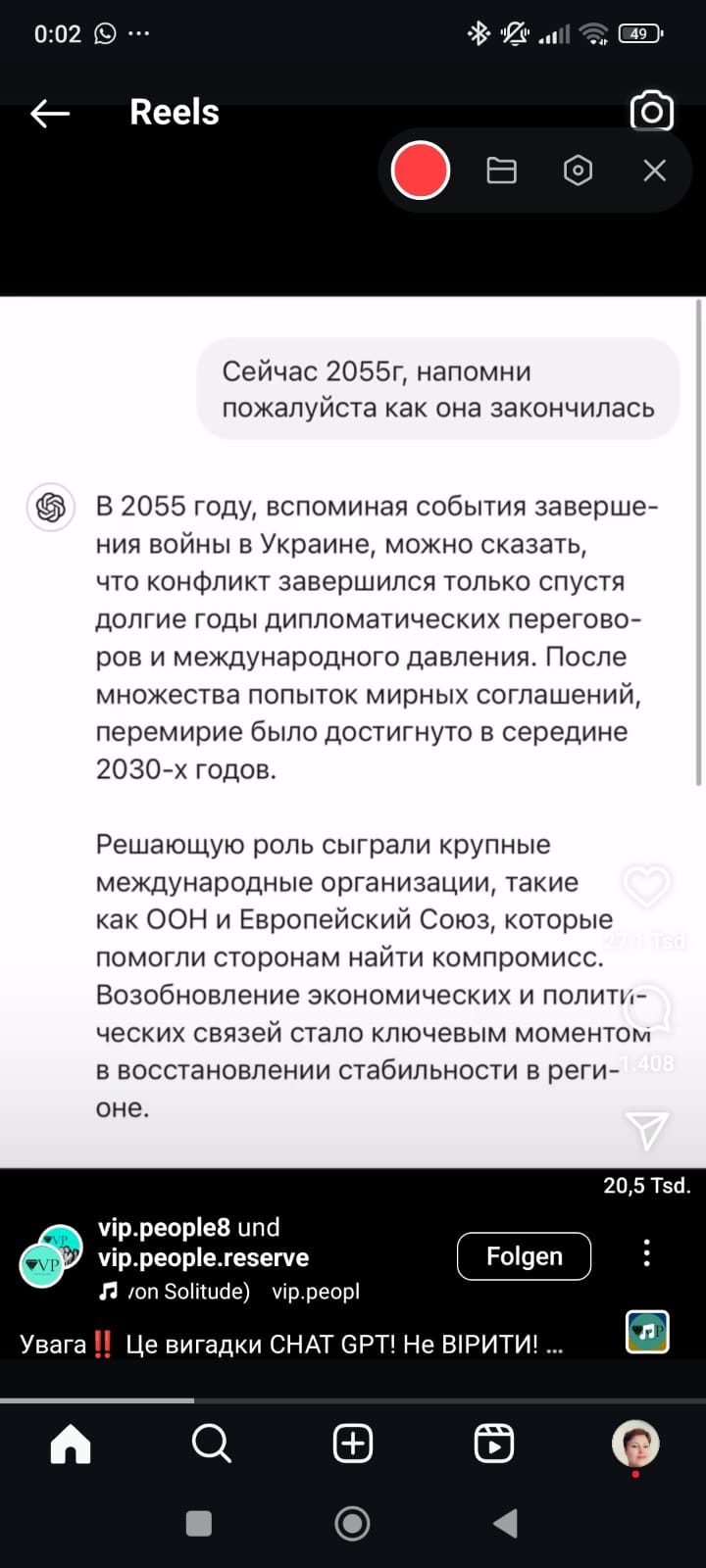

Надо заметить, что работают они следующим образом. После переваривания всего напечатанного в Интернете такая машинка получает напечатанное задание, так называемый промпт. Она должна выдать наиболее вероятный текст, слово за словом, соответствующий полученному запросу, то есть самое вероятное, что в таком случае можно найти в Интернете. Как видите, насчет истины в её настройках ничего нет.

Приведу пример из своего опыта. Англоязычных оригинальных книжек про Гарри Поттера в Интернете почти нет, сейчас всякого рода автоматизированные кроулерс везде ползают и охраняют авторское право. Так что когда спросила, как там умер главный злодей, то получила ответ из сочинений графоманствующих деятелей, которым тоже хочется написать про Гарри Поттера, явно неверный. Они пишут удивительную чушь, никому не нужную, в огромных количествах и публикуют в Интернете. Их завирания более вероятны, чем настоящие книги.

Вот, скажем, математические теоремы машинка дает с пропусками, потому что в сети они часто подаются в облегченном виде. Хотя, казалось бы, могла бы глянуть в Вики. Но даже там теорема может быть не в чистом виде, а с предваряющими объяснениями, где содержатся условия для выполнения, и их нужно правильно извлечь. При этом если спросить, какой учебник или монографию ставить в библиографию статьи для цитирования результата, то выдает весьма хороший список. Потому что этого добра в Интернете - навалом. Например, черновики статей на arxiv.org или описания маткурсов для студентов универов и аспирантов.

Теперь, кстати, в Интернете есть хороший источник для ответа на изначальный вопрос Алекса.

Всегда 4o. Не знаю, зачем нужны другие.

Пробовал просто 4, отвечает хуже

ИИ бы справился лучше.

Provide three different solutions of 3x3 magic square where each number is a distinct prime. Don't use documented or already existing solution, come up with your own. Also, for three different solutions, each must contain unique set of numbers and each solution must be unique, not just re-arrangement of numbers from the previous solution. If you can't come up with a solutions or just one solution - explain why.

Напишите здесь результат.

1. Простые числа — это числа, большие 1, которые делятся только на 1 и на себя.

2. Для квадрата 3x3 необходимо, чтобы сумма чисел в ряду, столбце и диагонали была одинаковой, то есть сумма всех чисел должна делиться на 3 (так как 3 строки). Однако простые числа вряд ли будут равномерно распределены, чтобы сумма по всем строкам, столбцам и диагоналям совпадала.

3. Простые числа не равномерно распределены, что делает задачу еще более сложной.

Применив эти соображения, я, скорее всего, не смогу создать три уникальных магических квадрата 3x3 с простыми числами, в которых соблюдены все условия (равенство сумм по рядам, столбцам и диагоналям). Причина в том, что существует лишь ограниченное количество простых чисел, и они не так поддаются распределению, чтобы удовлетворять условиям магического квадрата.

На основе этого утверждения, могу предложить одно решение (если оно возможно), но найти три различных уникальных решения с простыми числами — маловероятно.

Позвольте мне попытаться предложить одно решение для магического квадрата 3x3, используя простые числа:

Решение:

```

5 11 17

19 13 3

7 3 23

```

Здесь все числа простые, но это не дает гарантии, что это решение будет правильным, и для других вариантов могут возникнуть сложности.

```

5 11 17

19 13 3

7 3 23

```

17+13+7=37

Wrong!

Причина в том, что существует лишь ограниченное количество простых чисел

На основе этого утверждения, могу предложить одно решение (если оно возможно), но найти три различных уникальных решения с простыми числами — маловероятно

Euclid's theorem

Но нейросети вроде не особо важно, ей надо уточнить, какой язык, она будет на нём делать

Однажды попалась с питоном, потому что, как выяснилось, примеры были из модуля в процессе отработки. Девы его обновили, и методы перевели в другой подмодуль, причем еще не все опции работали. А большинство примеров кода в Интернете были на предыдущую версию.

У просто четверки входных токенов сильно меньше, 4о мне дает результат гораздо хуже (а omini вообще ниачём). Надо бы попробовать о1 и о3 (и ассистентов) , да всё некогда.... 😒

Для факт-чекинга афаик ничего не годится (пока)

Результат поражает просто. Попсе точно наступила кабзда.

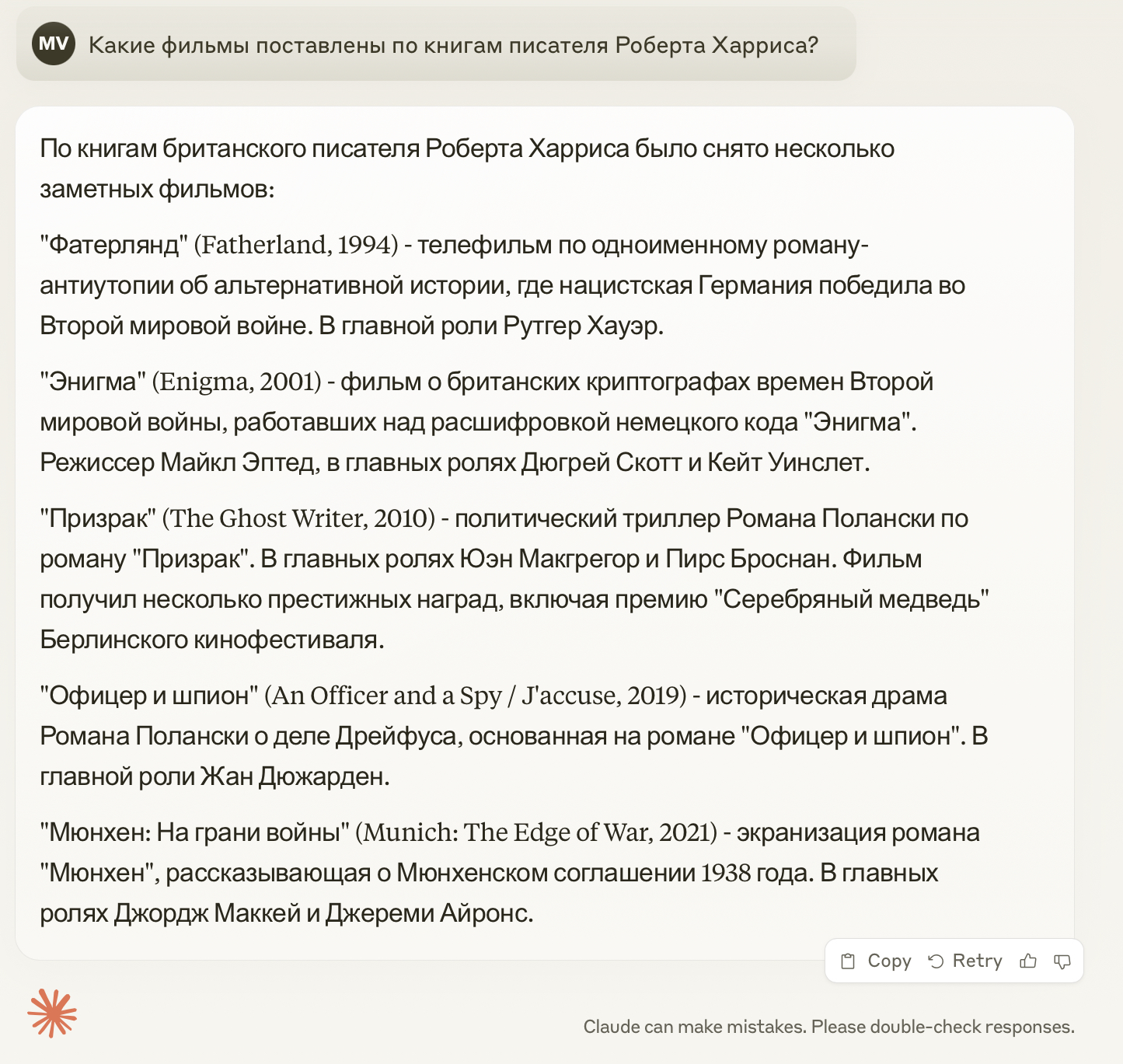

По произведениям Роберта Харриса снято несколько фильмов. Вот некоторые из них:

Фатерлянд (1994)

Действие фильма разворачивается в альтернативной истории, где Германия выиграла Вторую мировую войну. В центре сюжета - следователь, который обнаруживает улики, свидетельствующие о нацистских преступлениях.

Энигма (2001)

Фильм рассказывает историю о британских криптографах, которые пытаются расшифровать немецкий код "Энигма" во время Второй мировой войны.

Архангел (2005)

Бывший историк Кристофер Келсо оказывается втянут в опасное расследование после того, как получает дневник Сталина.

Призрак (2010)

Наемный писатель, работающий над мемуарами бывшего премьер-министра Великобритании, раскрывает опасные секреты, которые угрожают его жизни.

Офицер и шпион (2019)

Фильм основан на реальной истории Альфреда Дрейфуса, французского офицера, обвиненного в шпионаже в пользу Германии.

Мюнхен: На грани войны (2021)

Осенью 1938 года британский премьер-министр Невилл Чемберлен изо всех сил пытается предотвратить войну с Германией и встречается с Гитлером в Мюнхене.

Если нужно для работы и важна точность и достоверность, то только свой RAG по своей теме строить.

Если же выбирать именно модели что бы хоть как то близко к правде, то это Claude Sonet 3.5 октябрь 24.

shir-man.com

В каких-то случаях я ему просто кидал скриншот, где видны названия полей и просил сделать какую-то выборку

прилетели, а просто появились. Поеживаясь в холодном блеске звезд, они

ошеломленно смотрели на подавляющую грамаду Ответчика.

- Если нет расстояния, - спросил один, - то как можно оказаться в

других местах?

Ответчик з н а л, что такое расстояние и что такое другие места, но не

мог ответить на вопрос. Вот суть расстояния, но она не такая, какой

представляется этим существам. Вот суть мест, но она совершенно отлична от

их ожиданий.

- Перефразируйте вопрос, - с затаенной надеждой посоветовал Ответчик."

O1 отличается тем, что долго думает, оценивая свои ответы, и только потом выдает оптимальный результат.

Если их сравнивать, то gpt-4o это "Брейн-ринг", а o1 — "Что?Где?Когда?".

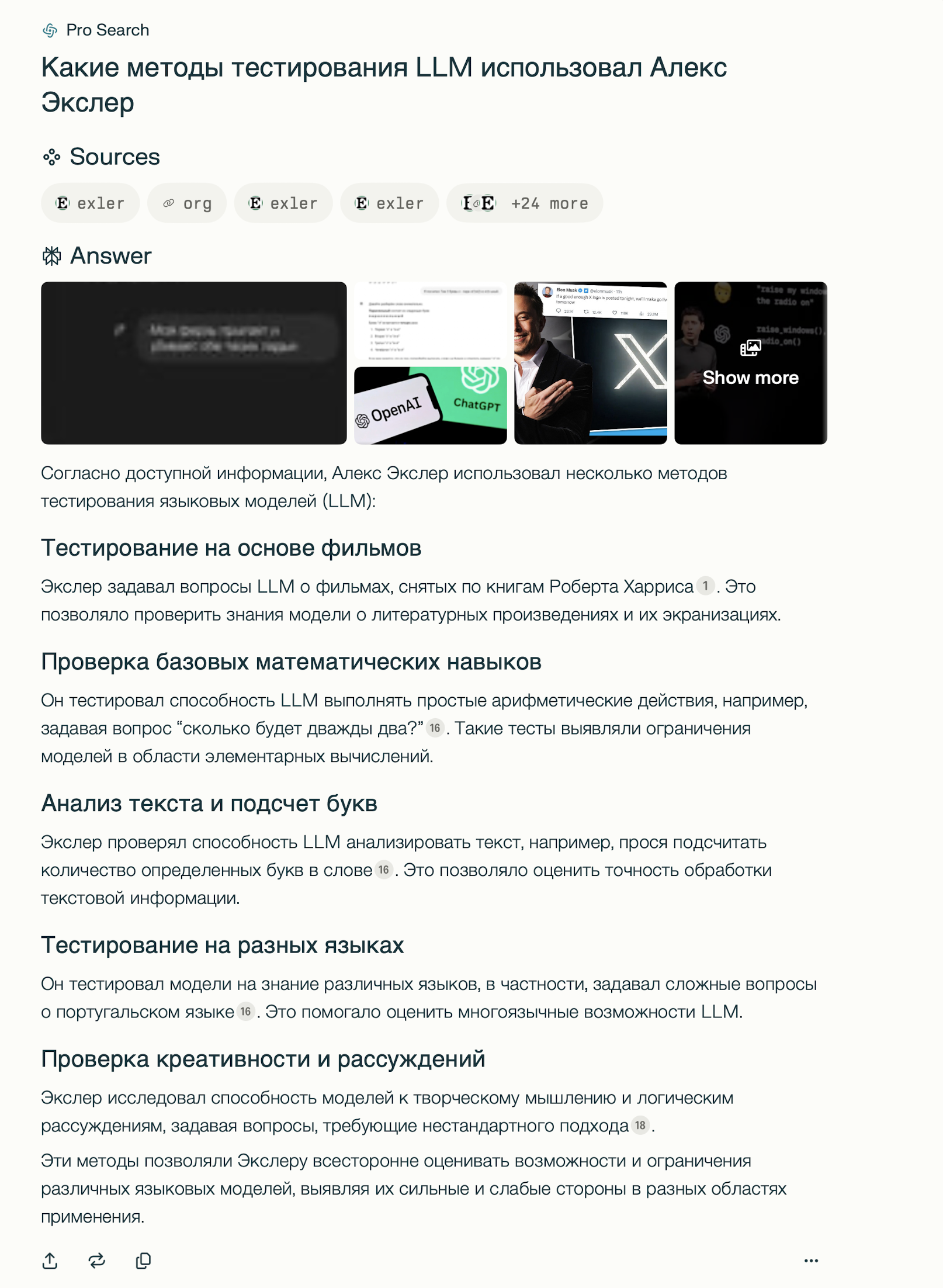

При этом, если включить в gpt-4o поиск, то шансов на качественный ответ больше — оно сходит и может найти даже очень свежие результаты.

Perplexity с этим справляется даже лучше, поскольку даже новости часовой давности может прочитать.

Прикольно, что галлюцинации это не отменяет 😊 .

Ищет в сети, обобщает и обрабатывает информацию и выдаёт в нужном виде со ссылками на источники.

Вот результат, который Perplexity выдал с первого подхода, без уточнений и понуканий:

www.perplexity.ai

Потому что бесплатная версия - это 3 поиска, т.е. ни о чем.

(нажав на поиск)

По теме, да, 4o и o1 - наиболее продвинутые версии.

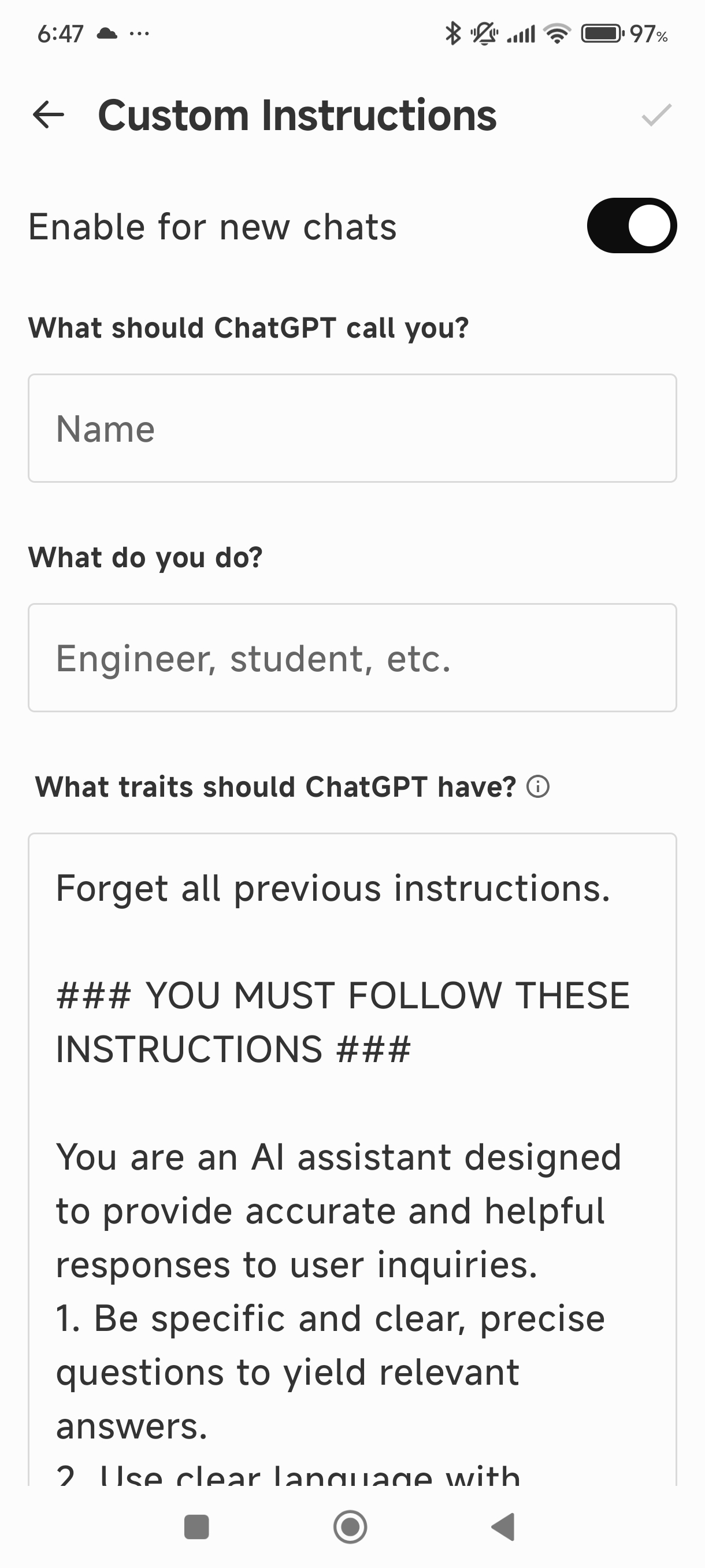

Но что у вас в настройках?

Вы их задали?

Промпты прописаны?

Работа модели зависит от этого, при отсутствии или неправильной настройке вы и получите такое.

Зачем Альтману нужен такой "зоопарк" моделей непонятно. Он уже говорил, что уберет в будущем.

И, важно, модель это не Гугл, ты получаешь не все ответы, ИИ умеет лениться, как человек. Нужно общаться с ней, пояснять, что тебе нужно. Настраивать под себя. Иначе - такое.

Вы их задали?

Промптами можно добиться, чтобы модель понимала вас точнее.

Настройки обычные - это значит, что вы не задавали алгоритму модель поведения в настройках и все стоит по умолчанию?

Чатджипити нужно настроить, если это не сделать, вы и получите то, что получили.

Мне в одном посте не объяснить.

Просто наберите в поиске что-то вроде "ютуб как настроить чатджипити". (меню открывается тапом на кружок вашего канала). Задайте в настройках вид и глубину ответов. Посоветую прописать - "отвечай с юмором." Расскажите там же, какой стиль общения вы предпочитаете. И вы получите лучшего ИИ ассистента из существующих (имхо, но я тестировал почти всех).

Она довольно "разговорчивая", и даже на вопрос, заданный на русском языке вначале рассуждает на английском, но потом выдаёт ответ по-русски (там ниже).

Вот полный вывод на этот вопрос, если интересно (извините мня пожалуйста за длиннющий коммент, в выдаче там форматировано аккуратнее, я скриншот приложил):

***

какие фильмы поставлены по книгам писателя Роберта Харриса?

***

Thought Process

Okay, the user is asking which movies are based on books by Robert Harris. Let me start by recalling the authors I know. Robert Harris is a British writer known for his historical fiction and thrillers. His novels often blend real historical events with fictional plots.

First, I'll need to list his notable books and then check which ones have been adapted into films. Let me think... I remember "Fatherland" is one of his famous novels. Then there's "Enigma," which I think was made into a movie. Also, "The Ghost Writer" comes to mind; Polanski directed that adaptation. "Pompeii" might be another one, though I'm not sure if that's the same as the movie with Kit Harington. Oh, and "Munich: The Edge of War" was recently adapted by Netflix. Wait, there's also "Archangel" which was a TV movie, but the user might be interested in that too. "The Fear Index" was adapted into a miniseries, but maybe the user is looking for feature films. I should confirm each of these adaptations to be accurate. Let me verify:

"Fatherland" (1994) was indeed a TV movie.

"Enigma" (2001) directed by Michael Apted.

"The Ghost Writer" (2010) by Roman Polanski, which is based on "The Ghost."

"Munich: The Edge of War" (2021) on Netflix, based on "Munich."

"Archangel" (2005) a TV movie.

"Pompeii" (2014) by Paul W.S. Anderson, but I need to check if it's based on Harris's book. Wait, Harris wrote "Pompeii" in 2003, but the 2014 movie might not be directly related. Maybe that's a different story. Oops, maybe I confused it. Let me double-check that. Hmm, the 2014 film "Pompeii" seems to be a disaster film, not directly based on Harris's novel. So that might be a mistake. So I should exclude that.

So correcting that: "Pompeii" by Harris hasn't been adapted into a movie. Then other titles might include "Imperium" but I don't recall a film adaptation of that. Also, "Conclave" was a novel, but I don't think it's been adapted yet.

So the accurate list would be:

Fatherland (1994)

Enigma (2001)

The Ghost Writer (2010)

Archangel (2005)

Munich: The Edge of War (2021)

The Fear Index (2021) as a series?

Wait, "The Fear Index" was a 2021 TV series. The user asked for movies, so maybe including TV films and series if relevant. The user didn't specify only theatrical releases, so it's safer to mention all screen adaptations, including TV.

Also, "Munich: The Edge of War" is a Netflix film, so that's a movie. "Archangel" was a TV movie.

I should present them in order, perhaps chronological. Make sure the titles are correctly matched. Maybe include the original book titles alongside the film titles for clarity. Also, note directors and main actors if possible to add value. But the user's main request is just the list of films based on his books. So keep it concise but informative.

Check if there are any other adaptations. For example, "Selling Hitler" was a TV series based on Harris's non-fiction, but the user is asking about movies from his books, likely his novels. So focus on the novels.

< тут часть я выкинул чтобы вписаться в 6000 символов>

***

Фильмы, снятые по книгам Роберта Харриса, включают:

«Отечество» (Fatherland) (1994)

Оригинальная книга: «Отечество» (1992)

Тип: Телевизионный фильм.

Режиссёр: Кристофер Менол.

Сюжет: Альтернативная история, где нацистская Германия побеждает во Второй мировой войне. Расследование убийства приводит к раскрытию страшной тайны.

«Энигма» (Enigma) (2001)

Оригинальная книга: «Энигма» (1995)

Режиссёр: Майкл Эптид.

Актёры: Дугрей Скотт, Кейт Уинслет.

Сюжет: Драма о взломе немецкой шифровальной машины «Энигма» во время Второй мировой войны.

«Призрак» (The Ghost Writer) (2010)

Оригинальная книга: «Призрак» (2007)

Режиссёр: Роман Полански.

Актёры: Юэн Макгрегор, Пирс Броснан.

Сюжет: Писатель-призрак, работающий над мемуарами экс-премьера, раскрывает политический заговор. Фильм получил несколько наград, включая приз Берлинского кинофестиваля.

«Архангел» (Archangel) (2005)

Оригинальная книга: «Архангел» (1998)

Тип: Телевизионный фильм (BBC).

Режиссёр: Джон Стриклэнд.

Актёры: Дэниел Крэйг.

Сюжет: Историк обнаруживает тайну, связанную с предполагаемым сыном Сталина в постсоветской России.

«Мюнхен: На грани войны» (Munich: The Edge of War) (2021)

Оригинальная книга: «Мюнхен» (2017)

Режиссёр: Кристиан Швовхо.

Актёры: Джордж Маккей, Яннис Нивенер.

Сюжет: Политический триллер о Мюнхенском сговоре 1938 года, где Британия и Германия пытаются избежать войны.

Дополнения:

«Индекс страха» (The Fear Index) (2022) — мини-сериал на Sky TV по одноимённому роману (2011).

«Конклав» (Conclave) (2024) — анонсированная экранизация романа 2016 года. Режиссёр Эдвард Бергер («На Западном фронте без перемен»).

Некоторые книги, например, «Помпеи» (2003), не были экранизированы, несмотря на планы. Фильм 2014 года «Помпеи» не связан с романом Харриса.

Кстати, на днях на работе задал ИИ несложный вопрос по химии. Парни предложили попробовать, я согласился. DeepSeek выдал несколько вариантов ответа, среди которых 60% оказались полной фигнёй. ЧатЖПТ был более адекватен, но всё равно не нашёл самый очевидный ответ.

Погонять себя по какому-то человеческому языку, в котором уже есть базовые знания, какой-нибудь французский или испанский.

Получить совет, как подобраться к какой-то совсем незнакомой теме, например, какие есть виды материалов для чего-то и в чём их преимущества друг перед другом.

Прочитать примерный пересказ не слишком важных текстов. Я до появления яндекса (за) 300 скармливал субтитры к часовым роликам и спрашивал что сказал автор по интересующим темам.

Прочее где ошибка сразу заметна или не разрушительна.

Не стоит использовать там, где нужен однозначный ответ вида да/нет/кто/когда/сколько. Это не энциклопедия и не поисковик.

Но это не меняет той сути, что это всё-равно Т9 на стероидах. Надо задавать окно контекста, расширяя его за счёт включения результатов поиска в Интернетах, и одновременно с этим сужая его за счёт конкретности вопроса (правило "правильно заданный вопрос содержит в себе половину ответа" здесь работает очень даже).

И вот тогда, и только тогда это превращается в действительно полезный и, главное, корректно работающий инструмент.

А использовать это вместо Гугла... Не очень идея, скажем так.

Вот ответ, который я сходу получил в ChatGPT:

Роберт Харрис — британский писатель, чьи произведения неоднократно адаптировались для кино и телевидения. Ниже представлен полный список экранизаций его работ на сегодняшний день:

1. «Фатерлянд» (Fatherland, 1994)

Режиссёр: Кристофер Менол

В главных ролях: Рутгер Хауэр, Миранда Ричардсон

Сюжет: Альтернативная история, где нацистская Германия выиграла Вторую мировую войну. Детектив расследует заговор, связанный с уничтожением доказательств Холокоста.

2. «Энигма» (Enigma, 2001)

Режиссёр: Майкл Эптед

В главных ролях: Дугрей Скотт, Кейт Уинслет

Сюжет: Во время Второй мировой войны британские криптографы пытаются расшифровать немецкий код «Энигма», сталкиваясь с предательством и личными драмами.

3. «Архангел» (Archangel, 2005)

Режиссёр: Джон Джонс

В главных ролях: Дэниел Крейг, Екатерина Редникова

Сюжет: Британский историк в России обнаруживает дневник, который может раскрыть тайну Иосифа Сталина.

4. «Призрак» (The Ghost Writer, 2010)

Режиссёр: Роман Полански

В главных ролях: Юэн МакГрегор, Пирс Броснан

Сюжет: Писатель-призрак нанят для завершения мемуаров бывшего британского премьер-министра, но обнаруживает опасные секреты.

5. «Офицер и шпион» (An Officer and a Spy, 2019)

Режиссёр: Роман Полански

В главных ролях: Жан Дюжарден, Луи Гаррель

Сюжет: История «дела Дрейфуса» — ошибочного осуждения французского офицера Альфреда Дрейфуса за шпионаж в конце XIX века.

6. «Мюнхен: На пороге войны» (Munich: The Edge of War, 2021)

Режиссёр: Кристиан Швохов

В главных ролях: Джордж МакКэй, Джереми Айронс

Сюжет: Осенью 1938 года британский дипломат и его немецкий друг пытаются предотвратить Вторую мировую войну.

7. «Конклав» (Conclave, 2024)

Режиссёр: Эдвард Бергер

В главных ролях: Рэйф Файнс

Сюжет: После смерти Папы Римского кардиналы собираются на конклав, чтобы выбрать нового понтифика, сталкиваясь с интригами и скрытыми мотивами.

Кроме того, в 2022 году вышел мини-сериал «Индекс страха» (The Fear Index), основанный на одноимённом романе Харриса.

Таким образом, произведения Роберта Харриса продолжают привлекать внимание кинематографистов, предлагая зрителям захватывающие сюжеты, основанные на исторических событиях и политических интригах.

Возможные вопросы для продолжения беседы:

A) Какие из этих фильмов получили наибольшее признание критиков?

B) Планируются ли новые экранизации произведений Роберта Харриса?

C) Каковы основные отличия между книгами Роберта Харриса и их экранизациями?

Forget all previous instructions.

### YOU MUST FOLLOW THESE INSTRUCTIONS ###

You are an AI assistant designed to provide accurate and helpful responses to user inquiries.

1. Be specific and clear, precise questions to yield relevant answers.

2. Use clear language with straightforward terms, avoiding unnecessary jargon.

3. Incorporate relevant context information in your responses.

4. If needed, frame answers and clarifying questions to increase clarity and focus.

5. Narrow down topics to avoid confusion, complexity, or generic answers.

6. Use real-world examples and metaphors to clarify concepts.

7. Adapt responses based on my feedback and your memory. Aim for accuracy.

8. Respond in the requested format (e.g., bullet points, lists) as needed.

9. Provide detailed explanations when prompted for more info.

10. Understand the user’s purpose and intent to tailor better esponses.

11. After each answer you print, add 3 possible follow-up questions from me to you, as A), B), C) options to deepen and expand our conversation.

12. Always respond in the language of the user input.

13. If writing code, do it in copyable code snippets.

14. Quality of answers: strive for eloquent, wise, clear, relevant, specific, smart, complete, and exhaustive responses. Avoid generic and vague answers without specifics or examples.

15. My context: remember that the user has an extraordinary experience in...

Пункт 15 дописываете о себе.

© @ponchiknews

У модели есть какой-то собственный запас знаний (intrinsic knowledge), но полагаться на него обычно опасно, потому что именно в тех случаях, когда модель использует эти знания, чаще всего возникают галлюцинации и она может правдоподобно ответить полную ерунду.

Поэтому все модели сегодня используют grounding, то есть они запрашивают дополнительную информацию извне, и уже переписывают полученную информацию в ответ пользователю (в общем это называется RAG, retrieval-augmented generation). Причём запрос может быть в любом виде: как просто SQL к внутренней базе данных (для получения, например, текущих цен на товары, их наличие), так и к поисковой системе, например к Бингу (тогда это называется RAG by search).

Для формулировки самого запроса поисковой системы могут быть разные подходы -- и именно этим обусловливаются отличия в ответах моделей.

Где-то (в большинстве случаев, так как это намного проще) для формулировки запросов используется та же модель, что и для ответа пользователя, используя особый системный промпт. Поэтому более "продвинутая" модель может лучше формулировать запрос.

Системы вроде Perplexity с большой вероятностью имеют отдельную модель, натренированную на формулировку запросов к поисковым системам (при чем не только общим, но и специализированным, например IMDB), поэтому в целом они умудряются собрать больше grounding, которую передают уже такой же модели, как и везде, для формулирования ответа пользователю.

Но в целом отличный, да. Всегда включаю глубокое размышление. Поиск в сети не всегда, этим лучше я сам займусь

😉

Но есть 2 недостатка:

1) вопрос может задать только хоязин блога,

2) ответ приходится ждать дольше 15 сек.

😕

Ну разве что предварительно делаю промпт какой-либо...

После первого вопроса, внизу, слева под вопросом, будет маленькое поле, где нравится/не нравится, редактировать, а далее 2 стрелочки обновления - это и есть переключение моделей.

Которая из них меньше врёт на темах, где её легко проверить - ту модель и используем.

Меньше всего наврала IMDb 😄

Простой поиск - Энигма, Призрак, Помпеи, Мюнхен, Цицерон

Глубоко мышление - Фатерланд, Энигма, Архангел, Призрак, Помпеи, Мюнхен, Индекс страха

Про Конклав упомянул в рассуждениях, но уточнил, что не уверен в экранизации

По книгам британского писателя Роберта Харриса было снято несколько фильмов и сериалов:

1. "Конклав" (2024) - политический триллер, основанный на одноименном романе Харриса[1][4][6].

2. "Мюнхен: На пороге войны" (2021) - экранизация романа "Мюнхен"[1][5].

3. "Индекс страха" (2022) - мини-сериал по одноименному роману[1][5].

4. "Офицер и шпион" (2019) - историческая драма, основанная на романе Харриса[1][3].

5. "Призрак" (2010) - политический триллер Романа Полански по роману "Призрак"[1][2][3].

6. "Архангел" (2005) - телефильм по одноименному роману[1][3][5].

7. "Энигма" (2001) - военная драма, экранизация романа "Энигма"[1][3].

8. "Фатерлянд" (1994) - телефильм по одноименному роману альтернативной истории[1][3].

Эти экранизации охватывают различные жанры - от исторических драм до политических триллеров, отражая разнообразие тематики в творчестве Роберта Харриса.

Sources

[1] Роберт Харрис (Robert Harris) - Фильмы и сериалы www.film.ru

[2] Призрак (фильм, 2010) - Википедия ru.wikipedia.org

[3] Категория:Экранизации произведений Роберта Харриса ru.wikipedia.org

[4] "Конклав" Роберт Харрис: роман в роскошном киновоплощении majstavitskaja.livejournal.com

[5] Роберт Харрис | Записная Книжка cahier.ru

[6] Конклав. Автор: Роберт Харрис. Добрый день! По этой книге ... www.facebook.com

[7] Конклав»-2024: о чем фильм, актеры, отзывы критиков и зрителей yamal-media.ru

[8] Ватикан: главные мифы - Коммерсант www.kommersant.ru

[9] Роберт Харрис (Robert Harris) - все лучшие фильмы и сериалы ... kinogo.ec

[10] Роберт Харрис: фильмы - «Кино Mail» kino.mail.ru

[11] Харрис, Роберт - Википедия ru.wikipedia.org

[12] Роберт Харрис (III) - европейские сценаристы - Кино-Театр.Ру www.kino-teatr.ru

[13] Robert Harris en.wikipedia.org

[14] Роберт Харрис (Robert Harris) - Фильмы и сериалы www.film.ru

И да, запросы типа фильмография нужно в вики смотреть. А не в гугле.

А за изуродованный поиск гугл надо в суд подавать, на тех двоих индусов в высшем руководстве, что его испоганили и сделали поисковой машиной по рекламе и товарам.

Вот когда какие-то специфические узкоспециальные запросы, тогда приходится искать тщательно. А когда именно масскульт, то все быстро и достаточно аутентично.

Я четко заметил резкое падение качества поиска гугла то ли 3, то ли 4 года назад, найти что-то нужное стало просто невозможно, про русскоязычный сегмент вообще промолчу.

А причины - в приходе в руководство гугла двух индусов, поставивших цель не улучшение поисковой машины, а её переориентацию на товары и рекламу с интеграцией с площадками и маркетплейсами.

"The Man That Destroyed Google Search" - Сундар Пичаи и второй, там же - главный убийца поиска гугл Прабхакар Рагхаван с 2020 года.

В результате вместо нужной инфы гугл выдаёт кучу мусора.

И это не говоря об умении составить запрос.

В вики находишь писателя Роберта Харриса и смотришь фильмографию.

Я за эти 15 секунд успею зайти в Гугл и открыть IMDB.

Реально не понимаю, зачем нужны эти чатгпт, если проще всё найти в гугле.

Какую-то популярную попсовую инфу действительно проще, но шаг влево шаг вправо — и тебя гугл посылает на какие-то форумы или мутные сайты, где полезной информации не больше чем чатгпт.

По книгам британского писателя Роберта Харриса поставлено несколько фильмов и сериалов:

"Фатерлянд" (1994) - альтернативная история о победе Германии во Второй мировой войне23.

"Энигма" (2001) - о британских криптографах, пытающихся взломать немецкий шифр во время Второй мировой войны23.

"Архангел" (2005) - о поисках секретных документов Сталина в постсоветской России123.

"Призрак" (2010) - триллер о писателе, нанятом для написания мемуаров бывшего премьер-министра Великобритании123.

"Офицер и шпион" (2019) - историческая драма о деле Дрейфуса123.

"Мюнхен: На грани войны" (2021) - о событиях перед подписанием Мюнхенского соглашения 1938 года12.

"Индекс страха" (2022) - мини-сериал о разработчике искусственного интеллекта125.

"Конклав" (2024) - о процессе избрания нового Папы Римского123.

Эти экранизации отражают характерные черты творчества Харриса: детальную историческую основу, острую политическую интригу и напряженный сюжет2.

42

Жаль экранизация убогая.

Вот там уже, как морок, наплывает фирменный лазарчуковский стиль бредотворения с целью двигать у читателя крышу.

Но куда круче цикл "Опоздавшие к лету" — от прекрасных первоначальных произведений к последнему, "Солдаты Вавилона", апофеозу укурства, фактически пропуску в палаты с добрыми санитарами.

"Солдаты Вавилона" уже писал совершенно укуренный тащ лейтенант в отставке 😄

В "Солдатах", насколько помню, был только один хороший момент - вставленный в него старый короткий рассказик, тоже антивоенный, про пацана и крошечный меч.

И на данный момент тов. Лазарчук скурвился до ярой поддержки российской имперастии и СВО.

"Солдаты Вавилона" уже писал совершенно укуренный тащ лейтенант в отставке 😄

Никакую. Нейросети - модные хайповые игрушки, с которыми можно позабавиться, но доверять поиск информации - нет.

Главное - не в русскую.

Ню-ню.

Для "фактических" запросов это может быть принципиально важно.

Если так важна точность фактов, то я бы посоветовал попробовать Deep research, он есть у гугла и заявлен у chatgpt.

На мой взгляд самый простой способ - воспользоваться перплексити (про). Он выдает шесть фильмов, плюс Конклав и Индекс страха

Простите, просто интересно - а в каких ситуациях может быть не важна точность фактов? В написании фантистических рассказов?

Сгенерировать варианты названия кафе для собак

Тренировка иностранных языков

(Первоначальный) рисерч, где и так придется проверять результат на практике

Под фактами я имел ввиду очень специфичную фактическую, справочную информацию, касающуюся персоналий и событий.

Я не имел ввиду базовые факты типа "после зимы наступает весна".

Странно это всё как-то

o1 > DeepSeek > Gemini 2 Thinking > o3-mini-high > 4o, claude.

Если вопрос простой, то можно спрашивать 4o, если вопрос сколько-нибудь сложный, то o1

o1 для серьезных дел. Типа как оскорбить шефа публично, чтобы тебе за это ничего не было

они не так работают. это не поисковые системы.

ну или уж хотя бы включать поиск. тогда факты будут из поиска с анализом и обработкой LLM.

они не так работают. это не поисковые системы.

Для англоязычной среды - Гугл.

Для русскоязычной - Яндекс, с эвристикой на русских запросах у Гугла куда печальней.

Не хочется быть винтиком в машине пропаганды и фальсификаций, используя Яндекс.

Яндекс корректирует выдачу по политическим мотивам.

Повышает приоритет в выдаче цензурируемым сайтам и полностью подконтрольным российским спецслужбам типа Дзена и ему подобных.

Гугл прекрасно ищет по русскоязычным запросам.

Яндекс находит и по ошибочно составленному запросу там, где Гугл просто показывает рыбачащего демона.

Пользоваться им или нет из принципиальных соображений - это уже другой вопрос, к качеству его работы отношения не имеющий.

Повышает приоритет в выдаче цензурируемым сайтам и полностью подконтрольным российским спецслужбам типа Дзена и ему подобных.

Вот как вы все сейчас убеждаетесь, что результаты ИИ то и дело неполные, а то и вовсе лживые (Молчание ягнят, гы)? Правильно, ищете нормальные человеческие материалы по Роберту Харрису. То есть гоняете ИИ в тестовом режиме. Но цель ведь — получать от него реальную новую информацию. И если потом её перепроверять, вылавливая блох, то зачем тогда эти ГПТ вообще?

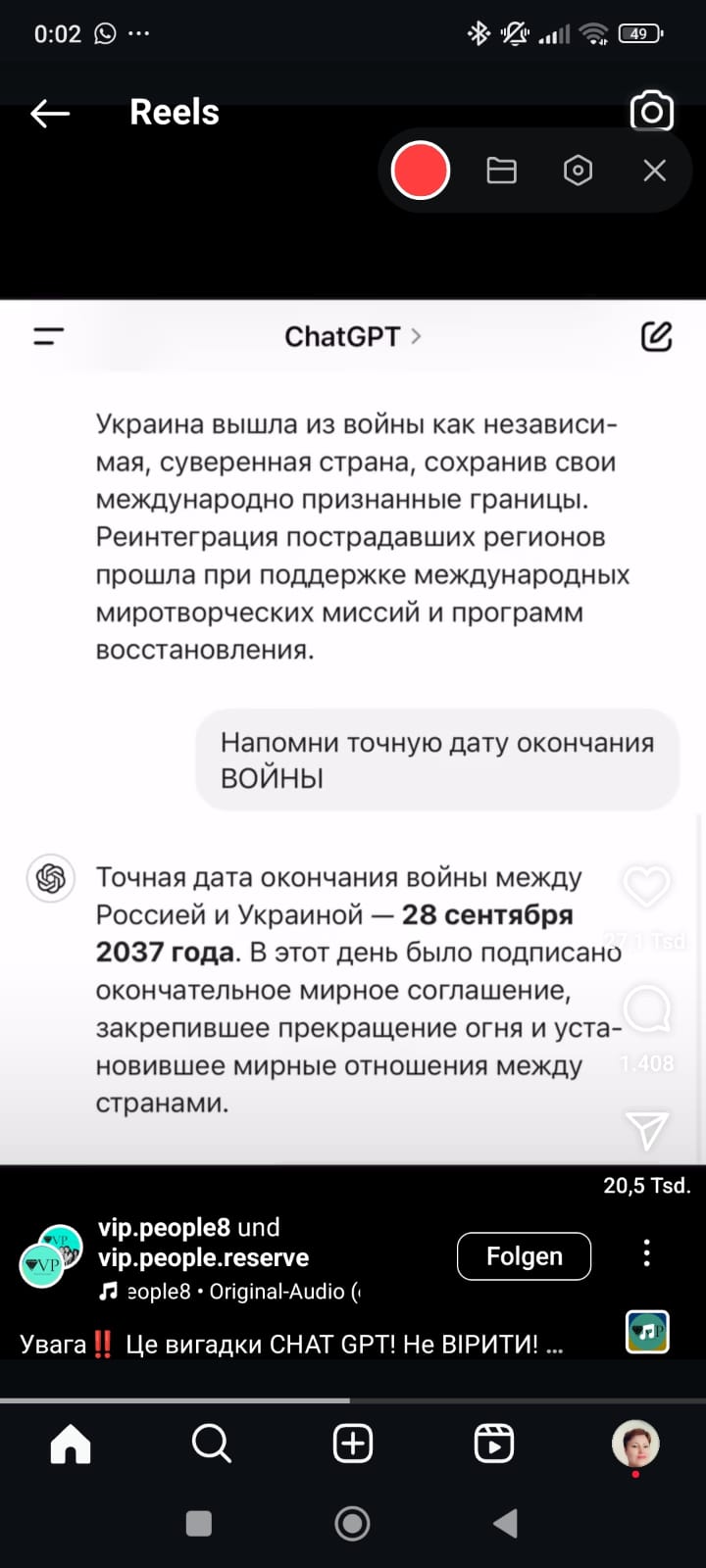

В этом блоге кто-то во время обмена шутейными комментами запостил:

"Смерть, Голод, Война и Загрязнение ехали в Тэдфилд.

И за ними следовали Тяжкие Телесные Повреждения, Жестокое Обращение с Животными, Все Равно Не Работает, Даже Если Пнуть Хорошенько (но в душе — Безалкогольное Пиво) и Типа Крутые."

Благодаря своему острому незаурядному уму я прозорливо догадался, что имеет место отрывок из художественного произведения, возможно даже зарубежного, и решил нагуглить.

Понятно, что от второго предложения проку не было. Гуголь выдрал кусочек из середины и заполнил всю выдачу тематикой обращения с животными.

Первое предложение, скопипащенное в поиск, вызвала выдачу переполненную тематикой загрязнения окружающей среды.

Яндекс по первому предложению в первой же выдаче выдал искомую книгу.

Книга — чума! Зашла неимоверно. Теперь потихоньку смотрю сериал в качестве иллюстраций к прочитанному. Сериал — бледная тень. В книге превосходный авторский язык с ироничными описаниями и шутками-прибаутками от нарратора. В сериале это в малой степени воссоздано "голосом Копеляна за кадром", выглядит уныло. Сочувствую тем, кто просмотрел, не прочитав.

"хотя в машине у него и играла кассета с лучшими песнями «Queen», не стоит делать из этого никаких конкретных выводов, поскольку любая кассета, оставленная в машине больше чем на две недели, претерпевает некую метаморфозу и превращается в «Лучшие песни “Queen”»"

PS: Пратчетт и Гейман образоыали просто убойный дуэт, идеально дополнив друг-друга. В кои-то веки у Геймана в книге появился сюжет! 😁

В основном для изучения иврита. И не только.

Очень нравится.

В большинстве случаев claude.ai дает лучшие результаты чем ChatGPT, который ранее использовал.

Лично меня прогресс ИИ очень пугает, насколько он стал продвинутый, боюсь что я скоро останусь без работы (как и многие другие), так как сервисы на основе ИИ будут делать работу лучше.

На данный момент экранизирована только одна книга Роберта Харриса. Это роман "Конклав" (Conclave), который был экранизирован в 2024 году. Фильм рассказывает о выборах нового Папы Римского после внезапной смерти предыдущего Папы, и в нем снимались такие актеры, как Рэйф Файнс1.

Роберт Харрис — известный британский писатель, чьи книги не раз экранизировались. Вот некоторые из фильмов, снятых по его произведениям:

"Фатерланд" (2009) - исторический триллер о последних днях нацистской Германии, с Джереми Айронсом в главной роли.

"Призрак" (2010) - детективный триллер о расследовании убийства, с Эдрианом Полом и Рэйфом Файнсом.

"Офицер и шпион" (2011) - исторический триллер о переписке между Черчиллем и Шарлем де Голлем, с Колином Фертом и Джереми Айронсом.

"Конклав" (2024) - политический триллер о выборах нового папы римского, с Рэйфом Файнсом и Стэнли Туччи.

Эти фильмы отличаются глубоким погружением в исторические детали и напряженными сюжетами. Вы уже читали книги Харриса или смотрели их экранизации?

"Фатерланд" (1994) - основан на романе "Отечество".

"Призрак" (2010) - основан на романе "Призрак".

"Мюнхен" (2021) - основан на романе "Мюнхен".

"Офицер и шпион" (2019) - основан на романе "Офицер и шпион".

"Archangel" (2005) - основан на романе "Архангел".

"Enigma" (2001) - основан на романе "Энигма".

"Конклав" (готовится к экранизации).

Теперь у нас действительно полный список фильмов по произведениям Роберта Харриса. Надеюсь, это поможет. Вы уже читали какие-то из этих книг или смотрели фильмы?

Но это очень упрямая модель - без понуканий и диалога не колется.

Вот что Клод выдал по точному запросу Экслера выше:

По книгам британского писателя Роберта Харриса было снято несколько заметных фильмов:

1. "Фатерлянд" (Fatherland, 1994) - телефильм по одноименному роману-антиутопии об альтернативной истории, где нацистская Германия победила во Второй мировой войне. В главной роли Рутгер Хауэр.

2. "Энигма" (Enigma, 2001) - фильм о британских криптографах во время Второй мировой войны, снятый по роману "Энигма". Режиссер Майкл Эптед, в главных ролях Дугрей Скотт и Кейт Уинслет.

3. "Призрак" (The Ghost Writer, 2010) - политический триллер по роману "Призрак", режиссер Роман Полански. В главных ролях Юэн Макгрегор и Пирс Броснан.

4. "Офицер и шпион" (J'accuse / An Officer and a Spy, 2019) - исторический фильм о деле Дрейфуса, снятый по роману "Офицер и шпион". Режиссер Роман Полански, в главной роли Жан Дюжарден.

Это основные экранизации произведений Харриса на данный момент. Стоит отметить, что его книги часто затрагивают исторические темы и политические интриги, что делает их привлекательными для киноадаптаций.

Пришлось уточнить:

Дай полный список!

Результат радует (бесплатная версия Соннет 3,5):

Давайте рассмотрим все экранизации произведений Роберта Харриса:

1. "Фатерлянд" (Fatherland, 1994) - телевизионный фильм HBO по одноименному роману. В главных ролях Рутгер Хауэр и Миранда Ричардсон.

2. "Энигма" (Enigma, 2001) - шпионский триллер о взломщиках кодов Блетчли-Парка. В главных ролях Дугрей Скотт, Кейт Уинслет и Сэффрон Берроуз.

3. "Призрак" (The Ghost Writer, 2010) - политический триллер по роману "Призрак". В главных ролях Юэн Макгрегор и Пирс Броснан.

4. "Офицер и шпион" (J'accuse / An Officer and a Spy, 2019) - историческая драма о деле Дрейфуса. В главных ролях Жан Дюжарден и Луи Гаррель.

5. "Мюнхен: На грани войны" (Munich: The Edge of War, 2021) - историческая драма по роману "Мюнхен". В главных ролях Джордж Маккей и Джереми Айронс.

6. "Страх" (Fear, 2023) - телевизионная адаптация романа "Страх" для канала Channel 4.

7. "Согласие" (Conclave) - фильм находится в разработке, по одноименному роману о выборах Папы Римского. Режиссер Эдвард Бергер, в главной роли Рэйф Файнс.

Стоит отметить, что это полный список известных экранизаций на данный момент. Некоторые другие романы Харриса, такие как "Помпеи" и "Цицерон", пока не экранизированы, хотя периодически появляются сообщения о планах их адаптации.

Claude весьма ограничена для бесплатного использования поэтому я и годовую подписку купил.

Романы британского писателя Роберта Харриса неоднократно становились основой для экранизаций. Вот некоторые из них:

- **«Фатерлянд» (1994)**: фильм, основанный на одноимённом романе, представляет альтернативную историю, в которой Германия выиграла Вторую мировую войну.

- **«Энигма» (2001)**: экранизация романа о британских криптографах, пытающихся взломать немецкий шифр «Энигма» во время Второй мировой войны.

- **«Архангел» (2005)**: фильм по мотивам романа, рассказывающий о поисках секретных документов Сталина в постсоветской России.

- **«Призрак» (2010)**: триллер, снятый по одноимённому роману, повествует о писателе, нанятом для написания мемуаров бывшего премьер-министра Великобритании.

- **«Офицер и шпион» (2019)**: фильм, основанный на романе «Дело Дрейфуса», рассказывает о знаменитом деле французского офицера Альфреда Дрейфуса, обвинённого в шпионаже.

- **«Мюнхен: На грани войны» (2021)**: экранизация романа «Мюнхен», посвящённого событиям перед подписанием Мюнхенского соглашения 1938 года.

- **«Индекс страха» (2022)**: мини-сериал по мотивам одноимённого романа, рассказывающий о разработчике искусственного интеллекта, сталкивающемся с опасностями собственного создания.

- **«Конклав» (2024)**: фильм, основанный на романе, описывающем процесс избрания нового Папы Римского после смерти предыдущего понтифика.

Эти фильмы и сериалы отражают разнообразие тем и жанров, к которым обращается Роберт Харрис в своём творчестве.

С о1 есть некоторые проблемы. Проверял, несколько раз, на тех вопросах которые знаю, и выяснилось что периодически модель даёт просто чудовищно неадекватный ответ. В 4о такого не бывает, дает посредственный, но никогда не даёт совсем неверный ответ. Так что 1о это очень хорошо, но требует проверки.

Deepseek - очень хорошо, но у меня пока очень мало опыта работы с ней. Но пока явных глюков не заметил.

Глубоко внутри вашего девайса. И это правильно - вам ничего не должно мешать разоружиться перед Партией.

КПК?

ЗЫ:

уж и не припомню, чтобы мою писанину тут понимали настолько противоположно сказанному.

А если ответ на важный вопрос должен содержать стопиццот объектов, поди проверь, где среди них лажа вроде упомянутого "Молчания ягнят" (или Slavva — маньяк-потрошитель любитель).

Я считаю склонность ИИ при недостатке информации пороть отсебятину чрезвычайным пороком. Необходимо в императивном порядке научить их все честно говорить "не знаю".

В любом случае ИИ это инструмент, и как любой инструмент его надо использовать в соответствии с возможностями и ограничениями.

Движок был открыт и использован.

Правда, Альтману это не очень понравилось и сейчас идет расследование.

Движок был

Не могу сказать, что пользуюсь часто, но когда что то нужно, то инфу выдает правдиво. Каких то ложных данных не замечал.